книги / Нечёткое, нейронное и гибридное управление

..pdf

выход данного k-формального измерительного нейрона обнуляется. Выходная функция первого цикла рабочего такта k-формального измерительного нейрона имеет следующий вид:

|

RнUПКН |

max |

k |

a3(k 1) |

|

a |

|

3 |

|

|

||||

UЭТjk |

|

|

|

|

|

|

|

|

3k |

sign aij ij 2 |

|

, |

||

|

|

2 |

|

2 |

k 1 |

2 |

k 1 |

|||||||

|

R |

|

|

i 2 |

|

|

|

|

j 1 |

|

|

|||

|

|

R |

|

|

|

|

|

|

|

|

||||

|

н |

3 |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

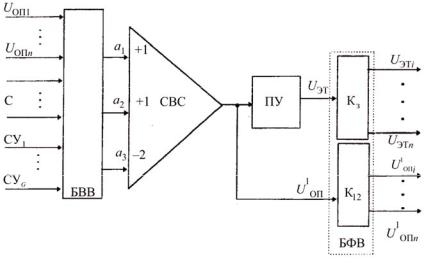

где а1…а3 – синапсы k-формального измерительного нейрона (k = 1 – n); 2 – порог k-формального измерительного нейрона; а3 – запрещающее волокно k-формального измерительного нейрона; а2 – разрешающее волокно k-формального измерительного нейрона; 1… 3 – весовые коэффициенты синапсов, где 1 = +1; 2 = +1; 3 = –2.

Отсюда математической моделью формального измерительного нейрона является модель, представленная на рис. 2.29.

Рис. 2.29. Дискретная математическая модель формального измерительного нейрона: БВВ – блок взаимодействия входных волокон; СВС – сумматор взвешенных сигналов; ПУ – пороговое устройство; БФВ – блок формирования выходных волокон; СУ1 – сравнивающее устройство

191

Итак, если возбужден синапс а1, т.е. осуществлена настройка и коммутация формального измерительного нейрона, возбужден синапс а2 и осуществляется первый цикл рабочего такта и отсутствует

а3, то sign [ ai i – 2] 0 [т.е. 1(+1)+1(+1)+0 (–2) – 2 = 0], т.е. фор-

мируется k-я составляющая UОП1 в сумме k 2ak3ii .

i 1

Если во втором цикле синапс а3 не возбуждается, то на выходе формального измерительного нейрона останется UОПi . Если же воз-

|

|

0 [т.е. 1(+1)+1(+1)+1(–2) – 2 = –2] и |

буждается а3, то sign ai wi – 2 |

||

формальный измерительный нейрон переходит в невозбужденное

состояние, т.е. UОПi 0.

Номер (адрес) подключаемых формальных измерительных нейронов задается с помощью блока взаимодействия входных волокон и блока формирования выходных волокон, причем блок формирования выходных волокон выполняет только соединительные функции, а блок взаимодействия входных волокон – автоматносоединительные. Различия в реализации формального измерительного нейрона лежат в разном строении блока взаимодействия входных волокон, который в основном определяется топологией применяемой эквисторной нейронной сети АЦП. Поэтому в дальнейшем при рассмотрении конкретной топологии нейронной сети необходимо обращать внимание и на конкретную реализацию блока взаимодействия входных волокон, ибо строение блока сумматора взвешенных сигналов, порогового устройства, блока формирования выходных волокон практически не изменяются от перехода к разным топологиям сетей.

Эквисторная нейронная сеть

На основе функционально-эволюционного системного подхода разработаны два типа эквисторной сети: детерминированная регулярная однородная и неоднородная структуры [40]. Для обоих типов структур разработаны основы архитектурных решений АЦП на базе применения обращенной матрицы R-2R и моделей формальных

192

измерительных нейронов следующих технологий: с монокристаллом линейного типа, с кольцевым монокристаллом, с яруснооднородной каскадной структурой [43].

Пример 2.5. Рассмотрим детерминированную регулярную однородную эквисторную структуру АЦП с потоковой динамической архитектурой и управлением данными с моноканалом линейной структуры.

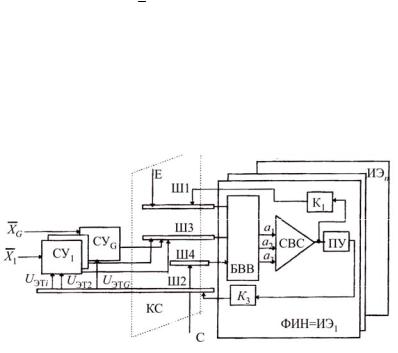

Архитектура преобразователя детерминированной регулярной однородной эквисторной структуры АЦП с потоковой динамической архитектурой и управлением данными с моноканалом линейной структуры представлена на рис. 2.30 (при этом рассматривается только измерительная часть).

Входные сигналы Xi , где i 1...G, поступают на первые входы сравнивающих устройств СУi , на вторые входы которых подается уравновешивающий сигнал UЭТi , формируемый измерительной

системой для соответствующего числа нейроподобных элементов. Нейронная сеть состоит из четырех шин: Ш1, Ш2, Ш3, количество разрядов в которых соответствует числу входных сигналов АЦП (G), и Ш4 – настроечная шина разрядностью С.

Рис. 2.30. АЦП с потоковой динамической архитектурой и управлением данными поразрядного кодирования на основе моноканала линейной структуры

193

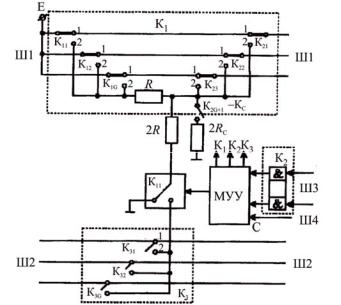

i-динамическая группа измерительных преобразователей образуется из j-нейроподобных элементов, которые последовательно (из числа свободных) подключаются через Ш1, Ш2 и Ш3 с помощью настроечной информации шины С (Ш4). Структура нейроподобных элементов с учетом алгоритма функционирования поразрядного кодирования, реализации на базе обращенной матрицы R-2R и топологии моноканала линейного типа нейронной сети приведена на рис. 2.31.

Формальный измерительный нейрон для моноканала линейного типа состоит из разряда R-2R с дополнительным резистором 2Rc для симметрирования матрицы, измерительного ключа КU и модульного устройства управления. Коммутатор К1 реализован на ключах К1i и К2i, К2 – на элементах 2И, коммутатор К3 – на ключах К3i.

Рис. 2.31. Структура нейроподобного элемента на обращенной матрице R-2R в моноканале линейного типа

194

Вкачестве базиса реализации принят элемент 2И-НЕ. С помо-

щью ключей K1i, K2i , K3i , схемы 2И и модульного устройства управления осуществляется включение j-нейроподобного элемента

вi-динамическую группу измерительных преобразователей. С помощью схем 2И к модульному устройству управления подключается соответствующий выход i-сравнивающего устройства через Ш3.

Врежиме рабочего функционирования модульное устройство

управления задает через ключ KU величину UЭТi соответствующего разряда, которое суммируется на усилителе постоянного тока и поступает на второй вход i-сравнивающего устройства. В зависимости

от соотношения Xi и UЭТi в соответствии с алгоритмом поразрядно-

го кодирования модуль устройства управления оставляет в «1» свой триггер или сбрасывает его в «0». По окончании q тактов работы i-динамической группы измерительных преобразователей на триггерах в модуле устройства управления формируется код измеренно-

го значения Xi . Процесс измерения окончен, и все i-нейро-

подобные элементы, участвовавшие в создании i-динамической группы измерительных преобразователей, переводятся в исходное состояние соответствующими i-модулями устройства управления путем переключения ключей К1i, К2i, К3i в положение 1. Далее процесс продолжается аналогично.

2.8. Адаптивный нейрон. Алгоритмы адаптации

Рассмотрим нечеткое управление с применением нейронной технологии. Постоянно растущая сложность и разнообразие задач, решение которых возлагается на автоматические системы, в последнее время определяют повышенную потребность в системах управления с более универсальными свойствами. Подходящими для решения большинства задач являются системы, основанные на нечеткой логике и ИНС [8, 50]. Нейронные сети выполняют решения, используя предшествующий опыт, что дает возможность приспособиться к изменениям в системе. Объединение элементов нечеткой логики (фаззификация) и НС позволят исключить недостатки не-

195

четкой логики и НС и проектировать адаптивные нечеткие регуляторы.

По сравнению с традиционными методами анализа (Приложение В и Г) и вероятностным подходом нечеткое управление с применением нейронной технологии позволяет проводить анализ задачи и получать результаты с заданной точностью, обеспечивать значительное повышение быстродействия процессов управления при использовании нейро-нечетких контроллеров и создание систем управления для объектов, где нецелесообразно применять методы традиционной математики. Мощь НС как методологии разрешения проблем гарантирует ее успешное использование в нечетких регуляторах напряжения БЩСГ.

Нечеткое регулирование с применением нейронной технологии повышает быстродействие, точность и качество регулирования. Позволяет работать с контурами, которыми раньше можно было управлять только вручную, в которых возможно лишь нелинейное регулирование.

Регулирование на основе нечеткой логики с применением ИНС на базе адаптивных нейронов является простым и надежным, в реализации есть альтернатива нейронному регулированию на базе нечетких нейронов. Впервые адаптация искусственного нейрона МакКаллока и Питтсона предложена Уидроу–Хоффа.

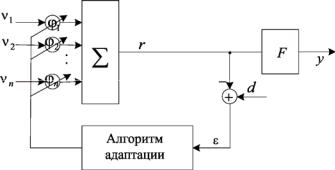

На рис. 2.32 показан адаптивный нейрон. Суть адаптации нейрона заключается в следующем.

На базе каждого нейрона создана следящая система, заданием которой является случайная величина, например отклонение напряжения от заданного значения. Задача следящей системы, меняя коэффициенты (синапсы) нейрона, отрабатывать отклонения между выходом сумматора соответствующего нейрона и заданием его следящей системы с помощью итерационной процедуры с переменным шагом (алгоритм адаптации Уидроу-Хоффа). Алгоритм адаптации подстраивает коэффициенты входной матрицы так, чтобы свести к нулю ошибку .

196

Рис. 2.32. Адаптивный нейрон

Процедурно это организуется сведением к минимуму квадрата ошибки. Воздействие выхода данного нейрона через активационную функцию и выходной нейрон НС парирует текущее отклонение от заданного значения с учетом инерционной системы.

В процессе адаптации происходит коррекция синапсов адаптивного нейрона до тех пор, пока желаемый сигнал d не станет равным нулю, т.е. система, исключая ошибку в статике, полностью адаптировалась. Сигналы с выхода сумматоров нейронов скрытого слоя через нелинейные активационные функции типа гиперболического тангенса либо сигмоидную функцию подаются на вход нейрона выходного слоя с нелинейной динамической активационной функцией, которая включается при выходе из зоны отклонения +5 % заданного напряжения и обеспечивает форсировку:

K K1 1 |

|

Uзад U |

|

|

|

Uзад U |

|

Kп |

при Uзад U 0, |

|

|

|

|

||||||

|

|

||||||||

|

|

|

|

||||||

K K 1 при Uзад U 0, |

|

||||||||

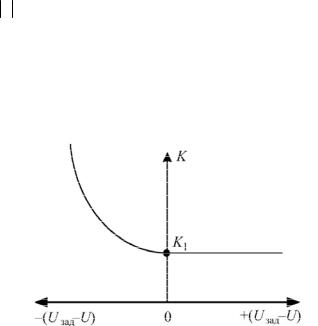

где К – динамическая активационная функция; К1 – статическая активационнаяфункция; Кп – коэффициент положительного модуля.

197

Управляющее воздействие y на РО (БЩСГ) ограничено по модулю y ymax .

На рис. 2.33 показана зависимость коэффициента активационной функции выходного нейрона от рассогласования текущего и заданного напряжений Достоинством алгоритма Уидроу–Хоффа является отсутствие ограничения на вид функции принадлежности (терма) и ее расположение в нормированном интервале, а недостатком – сравнительно низкое быстродействие.

Рис. 2.33. Зависимость коэффициента активационной функции выходного нейрона от рассогласования текущего

и заданного напряжений

Обучение нейрона с обратной связью с помощью алгоритма адаптации Уидроу–Хоффа

Уидроу и Хофф модифицировали персептронный алгоритм Ф. Розенблатта, дополнительно введя сигмоидальную функцию активации [27].

Их модели «Адлин» (с одним выходным нейроном) и «Мадалин» (много выходных нейронов) получили широкое распространение. Они доказали, что сеть при определенных условиях будет сходиться к любой функции, которую она может представить. Процедура Уидроу–Хоффа разработана применительно к «черному ящику», в котором между входами и выходами существуют только прямые связи. Процедура обучения «Мадалин» состоит в том, что

198

веса внутренних связей между нейронами подстраиваются до тех пор, пока не установится требуемое соотношение между входными и выходными векторами. Процесс состоит из двух чередующих фаз. В первой фазе на входах задается входной вектор, а на выходах – нужный выходной вектор. Затем веса всех связей, соединяющих активные входы и выходы, увеличиваются на малую величину . Во второй фазе на входе формируется тот же входной вектор, однако теперь самому «черному ящику» предоставлено право решать, какой вектор сформировать на выходе. При этом должно соблюдаться следующее правило: выход активизируется только тогда, когда сумма весов его связей с активными входами положительна. После этого веса всех связей, соединяющих активные входные и выходные элементы, уменьшаются на величину . Если сеть выработала правильный выходной вектор, то эти уменьшения весов в точности компенсируют их увеличение, произведенные в первой фазе, поскольку в обеих фазах активны одни и те же пары входвыход. Если же сеть выработала не тот выходной вектор, который нужен, то изменение весов, рассчитанных в первой фазе, сохраняется. При реализации алгоритма обучения персептрона «Адалин» появляется отличие от классического персептронного алгоритма в четвертом шаге, где используются непрерывные сигналы вместо бинарных сигналов. Недостатком процедуры Уидроу–Хоффа является требование наличия в «черном ящике» промежуточных слоев, которые бы выделяли из входного вектора иерархию тех его признаков, которые и определяли бы в конечном счете выбор выходного вектора. На практике с целью обучения нейрона его охватывают обратной связью через блок алгоритма адаптации.

Элемент сравнения в цепи обратной связи сравнивает фактический сигнал с выхода сумматора нейрона с желаемым сигналом d (это может быть ошибка регулирования в САР или производная ошибки регулирования). Алгоритм адаптации подстраивает коэффициенты вектора входных сигналов так, чтобы свести к нулю

ошибку d r . Процедурно это организуется сведением к минимуму квадрата ошибки:

2 |

(d r)2 , |

(2.1) |

199

где

n |

|

r wi xi . |

(2.2) |

i 1

Для решения данной безусловной оптимизационной задачи используем градиентный метод, или дельта-метод. В этом методе следующая (k + 1)-итерация для значения i-го весового коэффициента wi находится по формуле

wi (k 1) |

|

|

|

2 |

|

C, |

(2.3) |

|

wi (k) d( |

|

|

||||||

|

|

|

|

dwi |

|

k |

|

|

где С – положительная константа. |

|

|

|

|

|

|

||

Из (2.1) с учетом (2.2) следует, что |

|

|

|

|

|

|||

d( ) |

2 |

|

dr |

|

|

|

|

|

|

2 |

2 xi . |

(2.4) |

|||||

dwi |

|

|

||||||

|

|

dwi |

|

|

|

|

||

Тогда окончательное выражение для алгоритма адаптации будет иметь вид

wi (k 1) wi (k) 2C k xi (k), |

(2.5) |

где 2С – скорость обучения нейрона, определяемая скоростью сходимости итерационного процесса оптимизации.

Модифицированный метод наименьших квадратов обучения нейрона с обратной связью

Для повышения быстродействия рассмотрим алгоритм адаптации, основанный на модификации метода наименьших квадратов [17]. Данный алгоритм в отличие от алгоритма Уидроу–Хоффа рассчитывает синаптические веса Wkj нейрона за одну итерацию из

условия линейных терм-множеств фаззификатора лингвистической переменной (например, отклонение текущего параметра). После

200